Research

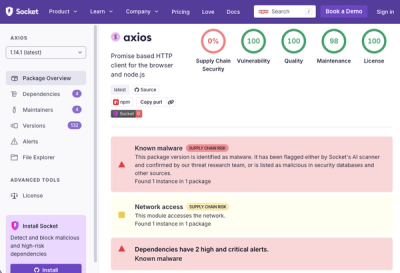

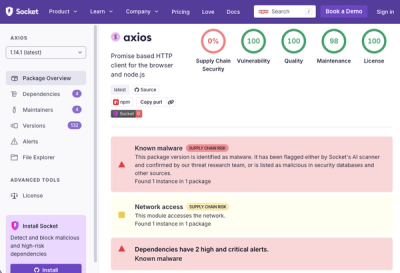

Supply Chain Attack on Axios Pulls Malicious Dependency from npm

A supply chain attack on Axios introduced a malicious dependency, plain-crypto-js@4.2.1, published minutes earlier and absent from the project’s GitHub releases.

这个仓库包含了 DONE CLI(Gemini ClI 的 Fork 版本),一个连接到您的工具、理解您的代码并加速您工作流程的命令行 AI 工具。它支持多种 LLM 提供商,包括 Gemini、OpenAI 以及任何遵循 OpenAI API 格式的自定义 LLM API。

使用 DONE CLI,您可以:

本方案已经对多种不同提供商、模型以及本地部署的模型进行了多个维度(是否具备思考过程、能否完成简单任务、是否具备工具调用能力、是否具备多模态能力、是否具备复杂任务能力、是否可以统计 Toekn)的测试,以下是测试结果:

| 模型 | 思考过程 | 简单任务 | 工具调用 | MCP 调用 | 复杂任务 | 多模态 | Token 统计 | | ----------------------------- | -------- | -------- | -------- | -------- | -------- | ------ | ---------- | --- | | 【Google】Gemini-2.5-pro | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ | | 【OpenRouter】Claude Sonnet 4 | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ | | 【OpenRouter】Gpt-4.1 | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ | | 【OpenRouter】Grok-4 | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ | | 【Volcengine】Doubao-Seed-1.6 | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ | | 【Bailian】Qwen3-Plus | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ | ✅ | | 【Moonshot】kimi-k2 | ✅ | ✅ | ✅ | ✅ | ✅ | ❌ | ✅ | | 【Volcengine】DeepSeek-R1 | ✅ | ✅ | ✅ | ✅ | ✅ | ❌ | ✅ | | 【Siliconflow】DeepSeek-R1 | ✅ | ✅ | ✅ | ✅ | ✅ | ❌ | ✅ | | 【Volcengine】Doubao-1.5-Pro | ❌ | ✅ | ✅ | ✅ | ⚠️ | ❌ | ✅ | | 【Volcengine】DeepSeek-V3 | ❌ | ✅ | ✅ | ✅ | ⚠️ | ❌ | ✅ | | 【Bailian】Qwen3-235b-a22b | ✅ | ✅ | ✅ | ✅ | ⚠️ | ❌ | ✅ | | 【vLLM】Qwen2.5-7B-Instruct | ❌ | ✅ | ✅ | ✅ | ⚠️ | ❌ | ✅ | | 【vLLM】DeepSeek-R1--32B | ✅ | ✅ | ✅ | ✅ | ⚠️ | ❌ | ✅ | | 【Ollama】Qwen2.5-7B-Instruct | ❌ | ✅ | ✅ | ✅ | ⚠️ | ❌ | ✅ |

npx donecode

或者使用以下命令安装:

npm install -g donecode

dcode

Done LLM 命令行工具支持连接到任何兼容 OpenAI 的 LLM API。你可以使用以下环境变量配置首选的 LLM:

# 启用自定义 LLM 支持

export USE_CUSTOM_LLM=true

export CUSTOM_LLM_API_KEY="your-api-key" # 你的 LLM 提供商 API 密钥

export CUSTOM_LLM_ENDPOINT="https://api.your-llm-provider.com/v1" # API 端点

export CUSTOM_LLM_MODEL_NAME="your-model-name" # 模型名称

# 可选参数

export CUSTOM_LLM_TEMPERATURE=0.7 # 温度参数(默认值:0)

export CUSTOM_LLM_MAX_TOKENS=8192 # 最大令牌数(默认值:8192)

export CUSTOM_LLM_TOP_P=1 # Top P 参数(默认值:1)

当这些变量设置后,Done LLM 命令行工具将使用你的自定义 LLM,而非默认的 Gemini 模型。

一旦 CLI 运行起来,你就可以从 shell 中与 Gemini 交互了。

你可以从新目录开始一个项目:

cd new-project/

dcode

> 帮我写一个 Discord 机器人,它能使用我将要提供的 FAQ.md 文件来回答问题

或者处理一个已有的项目:

git clone https://gitlab.ctyuncdn.cn/devops/codeai/donecode

cd donecode

dcode

> 给我总结一下昨天所有的变更内容

Done LLM 支持直接在代码中通过 NPM 引入并使用:

import { dcodeAgent } from "donecode";

const agent = new dcodeAgent({

model: "custom-llm-model-name",

apiKey: "custom-llm-api-key",

endpoint: "custom-llm-endpoint",

extension: {

mcpServers: {

chart: {

command: "npx",

args: ["-y", "@antv/mcp-server-chart"],

trust: false,

},

},

excludeTools: ["run_shell_command"],

},

});

const result = await agent.run("请帮我生成一个销售数据的柱状图");

console.log(result);

如果遇到问题,请查看故障排除指南。

首先进入一个已有的或新克隆的仓库,然后运行 dcode。

> 描述这个系统架构的主要组成部分。

> 有哪些安全机制在运行?

> 为 GitHub 第 123 号 issue 实现初稿。

> 帮我把这个代码库迁移到最新版本的 Java。先制定一个计划。

使用 MCP 服务器将本地系统工具与企业协作套件集成。

> 制作一个幻灯片,展示过去 7 天的 git 历史,按功能和团队成员分组。

> 制作一个全屏网页应用,用于墙上显示器,展示我们互动最多的 GitHub 问题。

> 将此目录中的所有图像转换为 png 格式,并根据 exif 数据中的日期重命名。

> 按支出月份整理我的 PDF 发票。

FAQs

We found that donecode demonstrated a healthy version release cadence and project activity because the last version was released less than a year ago. It has 1 open source maintainer collaborating on the project.

Did you know?

Socket for GitHub automatically highlights issues in each pull request and monitors the health of all your open source dependencies. Discover the contents of your packages and block harmful activity before you install or update your dependencies.

Research

A supply chain attack on Axios introduced a malicious dependency, plain-crypto-js@4.2.1, published minutes earlier and absent from the project’s GitHub releases.

Research

Malicious versions of the Telnyx Python SDK on PyPI delivered credential-stealing malware via a multi-stage supply chain attack.

Security News

TeamPCP is partnering with ransomware group Vect to turn open source supply chain attacks on tools like Trivy and LiteLLM into large-scale ransomware operations.